DeepFake Ինչ է դա և ինչպես են նրանք աշխատում արհեստական ինտելեկտի հետ:

Իմացեք, թե ինչպես և որտեղ ստեղծել արագ և հեշտ DeepFake

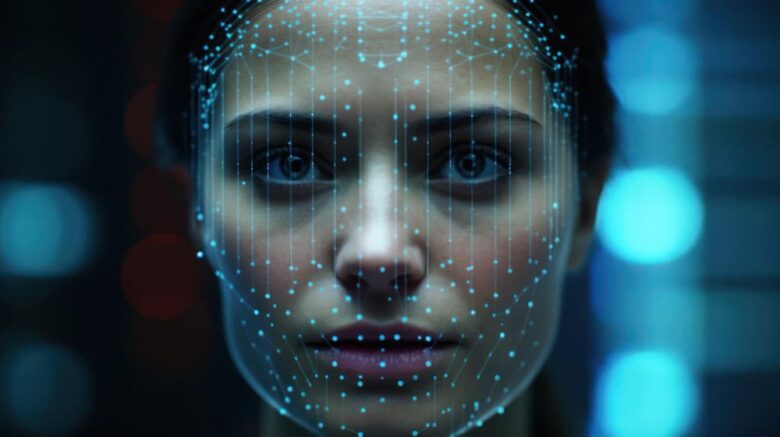

Deepfakes-ը մանիպուլյացիայի ենթարկված տեսանյութ կամ աուդիո է, որը թույլ է տալիս թվալ, թե ինչ-որ մեկն ասում կամ անում է մի բան, որը երբեք չի ասել կամ արել: Դրանք ստեղծվել են արհեստական ինտելեկտի (AI) տեխնիկայի միջոցով՝ մեկի դեմքը կամ ձայնը մյուսի դեմքով փոխարինելու համար:

Մյուս կողմից, deepfakes-ը կարող է ստեղծել ցանկացած մարդ, ով ունի համակարգիչ և ինտերնետ կապ: Կան բազմաթիվ անվճար հավելվածներ և կայքեր, որոնք օգտատերերին թույլ են տալիս ստեղծել իրենց սեփական խորը ֆեյքերը:

Մարդիկ օգտագործում են նաև արհեստական ինտելեկտի հավելվածներ՝ վնասակար բովանդակություն ստեղծելու համար, ինչպիսիք են խորը ֆեյքերը, որոնք կարող են օգտագործվել ապատեղեկատվություն տարածելու համար: Դրանք կարող են օգտագործվել տարբեր նպատակներով, այդ թվում՝ զվարճանքի, կրթության և քարոզչության համար: Այս պահվածքից պետք է խուսափել:

Ինչպե՞ս է աշխատում խորը ֆեյքը:

Deepfakes-ը ստեղծվում է AI տեխնիկայի միջոցով, որը կոչվում է խորը նյարդային ցանցեր: Խորը նյարդային ցանցերը արհեստական ինտելեկտի մի տեսակ են, որը ներշնչված է մարդու ուղեղով: Նրանք կարող են սովորել կատարել բարդ առաջադրանքներ՝ վերլուծելով մեծ քանակությամբ տվյալներ:

Դիփֆեյքերի դեպքում խորը նեյրոնային ցանցերն օգտագործվում են՝ սովորելու ճանաչել մարդու դեմքի և ձայնային հատկությունները: Երբ խորը նեյրոնային ցանցը սովորի ճանաչել մարդու դեմքի և ձայնային հատկությունները, այն կարող է օգտագործվել մեկի դեմքը կամ ձայնը փոխարինելու մեկ այլ անձի դեմքը կամ ձայնը:

Ինչպե՞ս կարելի է հայտնաբերել Deepfakes-ը:

Դիփֆեյքերը հայտնաբերելու մի քանի եղանակ կա: Ճանապարհներից մեկը տեսանյութում կամ աուդիոում կեղծման նշաններ փնտրելն է: Օրինակ, Deepfakes-ը հաճախ խնդիրներ ունի շուրթերի համաժամացման կամ դեմքի արտահայտության հետ:

Դիփֆեյքերը հայտնաբերելու մեկ այլ միջոց է դատաբժշկական վերլուծության գործիքների օգտագործումը: Այս գործիքները կարող են բացահայտել կեղծման ազդանշանները տեսագրության կամ աուդիոի մեջ, որոնք մարդու աչքը չի կարող տեսնել:

Որո՞նք են Deepfakes-ի վտանգները:

Deepfakes-ը կարող է օգտագործվել ապատեղեկատվություն տարածելու, մարդկանց արատավորելու կամ նույնիսկ ընտրությունները կեղծելու համար: Օրինակ, դիփֆեյքը կարող է օգտագործվել, որպեսզի քաղաքական գործիչն ասի մի բան, որը երբեք չի ասել: Սա կարող է էական ազդեցություն ունենալ ընտրությունների վրա և կարող է հանգեցնել նրան, որ մարդիկ քվեարկեն մեկի օգտին, ում օգտին այլ կերպ չէին քվեարկի:

Ինչպե՞ս կարող ենք պաշտպանվել Deepfakes-ից:

Կան մի քանի բան, որ մենք կարող ենք անել, որպեսզի պաշտպանվենք խորը կեղծիքներից: Ճանապարհներից մեկն այն է, որ տեղյակ լինեք խորը ֆեյքերի ռիսկերի մասին: Մեկ այլ միջոց է քննադատաբար վերաբերվել այն տեղեկատվությանը, որը մենք տեսնում ենք առցանց: Եթե մենք տեսնում ենք տեսանյութ կամ աուդիո, որը չափազանց լավ է թվում, որ ճիշտ լինի, հավանաբար դա այդպես է: Մենք կարող ենք նաև օգնել՝ հաղորդելու deepfakes-ի մասին: Եթե մենք տեսնում ենք խորը կեղծիք, մենք կարող ենք դրա մասին հայտնել իշխանություններին կամ կիսվել ուրիշների հետ, որպեսզի նրանք տեսնեն այն:

Deepfakes-ը նոր տեխնոլոգիա է, որը կարող է օգտագործվել բարու կամ չարի համար: Մենք պետք է տեղյակ լինենք deepfakes-ի ռիսկերին և միջոցներ ձեռնարկենք դրանցից պաշտպանվելու համար։