DeepFake Што гэта такое і як яны працуюць са штучным інтэлектам?

Даведайцеся, як і дзе стварыць DeepFake хутка і лёгка

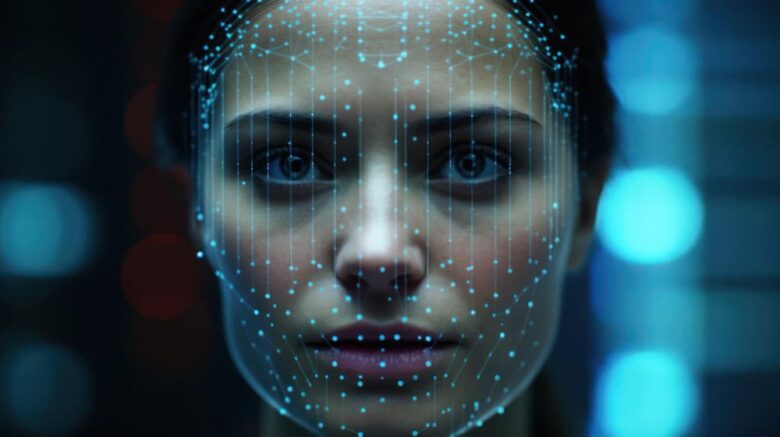

Глыбокія падробкі - гэта маніпуляваныя відэа ці аўдыя, якія ствараюць уражанне, што нехта кажа або робіць тое, што ніколі не казаў і не рабіў. Яны ствараюцца з дапамогай метадаў штучнага інтэлекту (AI), каб замяніць твар або голас аднаго чалавека тварам або голасам іншага.

З іншага боку, дыпфейкі можа ствараць кожны, хто мае доступ да камп'ютара і падключэнне да Інтэрнэту. Ёсць шмат бясплатных праграм і вэб-сайтаў, якія дазваляюць карыстальнікам ствараць уласныя дыпфейкі.

Людзі таксама выкарыстоўваюць прыкладанні штучнага інтэлекту для стварэння шкоднага кантэнту, напрыклад дыпфейкаў, якія можна выкарыстоўваць для ачарнення або распаўсюджвання дэзінфармацыі. Іх можна выкарыстоўваць у розных мэтах, у тым ліку для забавы, адукацыі і прапаганды. Варта пазбягаць такіх паводзін.

Як працуе Deepfake?

Deepfakes ствараюцца з выкарыстаннем метадаў штучнага інтэлекту, якія называюцца глыбокімі нейронавымі сеткамі. Глыбокія нейронныя сеткі - гэта тып штучнага інтэлекту, які натхнёны чалавечым мозгам. Яны могуць навучыцца выконваць складаныя задачы, аналізуючы вялікія аб'ёмы дадзеных.

У выпадку з дыпфейкамі глыбокія нейронныя сеткі выкарыстоўваюцца, каб навучыцца ідэнтыфікаваць рысы твару і галасы чалавека. Калі глыбокая нейронная сетка навучылася ідэнтыфікаваць рысы твару і голас чалавека, яе можна выкарыстоўваць для замены твару або голасу аднаго чалавека тварам або голасам іншага.

Як вы можаце выявіць Deepfakes?

Ёсць некалькі спосабаў выявіць дыпфейкі. Адзін са спосабаў - шукаць прыкметы маніпуляцыі ў відэа ці аўдыё. Напрыклад, у deepfakes часта ўзнікаюць праблемы з сінхранізацыяй вуснаў або выразам твару.

Іншы спосаб выяўлення дыпфейкаў - выкарыстанне інструментаў крыміналістычнага аналізу. Гэтыя інструменты могуць ідэнтыфікаваць прыкметы фальсіфікацыі відэа ці аўдыя, якія не бачныя чалавечаму воку.

Якія рызыкі Deepfakes?

Deepfake можна выкарыстоўваць для распаўсюджвання дэзінфармацыі, паклёпу на людзей ці нават маніпулявання выбарамі. Напрыклад, дыпфейк можа быць выкарыстаны, каб зрабіць так, каб палітык сказаў тое, чаго ніколі не казаў. Гэта можа істотна паўплываць на выбары і можа прывесці да таго, што людзі прагаласуюць за таго, хто інакш бы не прагаласаваў.

Як мы можам абараніць сябе ад Deepfakes?

Ёсць некаторыя рэчы, якія мы можам зрабіць, каб абараніць сябе ад дыпфейкаў. Адзін са спосабаў - ведаць пра рызыку дыпфейкаў. Іншы спосаб - крытычна ставіцца да інфармацыі, якую мы бачым у Інтэрнэце. Калі мы бачым відэа ці аўдыя, якія здаюцца занадта добрымі, каб быць праўдай, верагодна, так і ёсць. Мы таксама можам дапамагчы паведаміць пра deepfake. Калі мы бачым дыпфейк, мы можам паведаміць пра гэта ўладам або падзяліцца ім з іншымі, каб яны маглі гэта ўбачыць.

Deepfakes - гэта новая тэхналогія, якая можа быць выкарыстана на карысць ці на зло. Мы павінны ўсведамляць рызыкі дыпфэйкаў і прымаць меры, каб засцерагчы сябе ад іх.